無論你願不願意、承不承認,AI 會比你更瞭解你自己,這些數據和演算的結果,可能會成為貸款的信用分數、看病的用藥依據、甚至是犯罪的呈堂證供。 再更進一步,AI 其實會回過頭來操縱個人意志,決定我們該買什麼、該看什麼、該吃什麼,甚至,票投給誰。

|

目錄 |

ChatGPT是一款由OpenAI開發的大型語言模型,可以生成自然流暢的文字,能夠回答用戶的問題、提供建議、完成任務等。ChatGPT訓練自眾多的文本資料,擁有龐大的知識庫和自然語言處理能力,可以處理許多不同領域的問題。

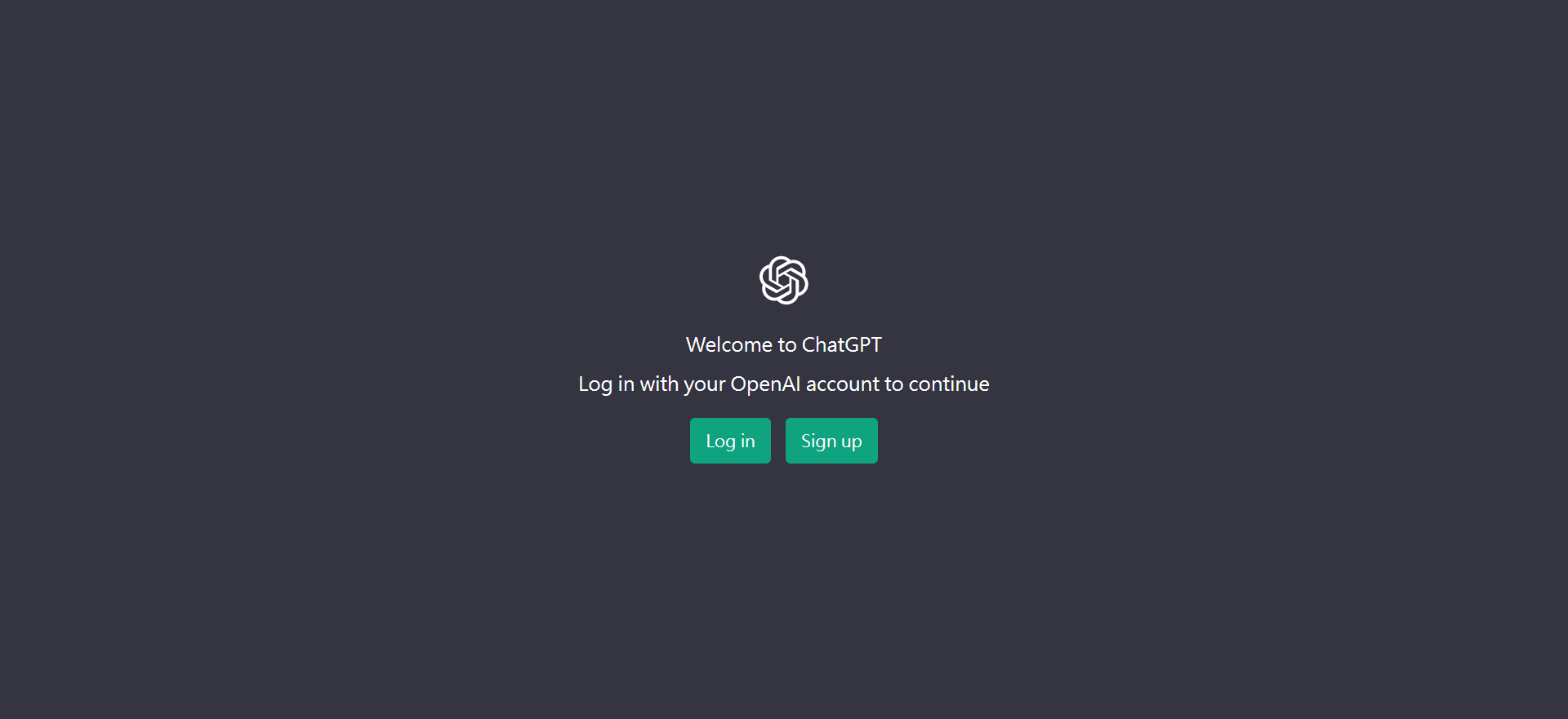

1、註冊(免費)

使用ChatGPT需要先註冊一個帳號。目前,OpenAI提供免費和付費兩種服務方案,您可以選擇使用免費版本或付費版本。如果您想使用免費版本,只需前往OpenAI網站並註冊一個帳號即可。

選擇「Sign up」,依網頁輸入必要的信箱、密碼、手機等資訊。完成驗證。回到首頁,點擊「Log in」就可登入

ChatGPT官網:https://chat.openai.com/auth/login

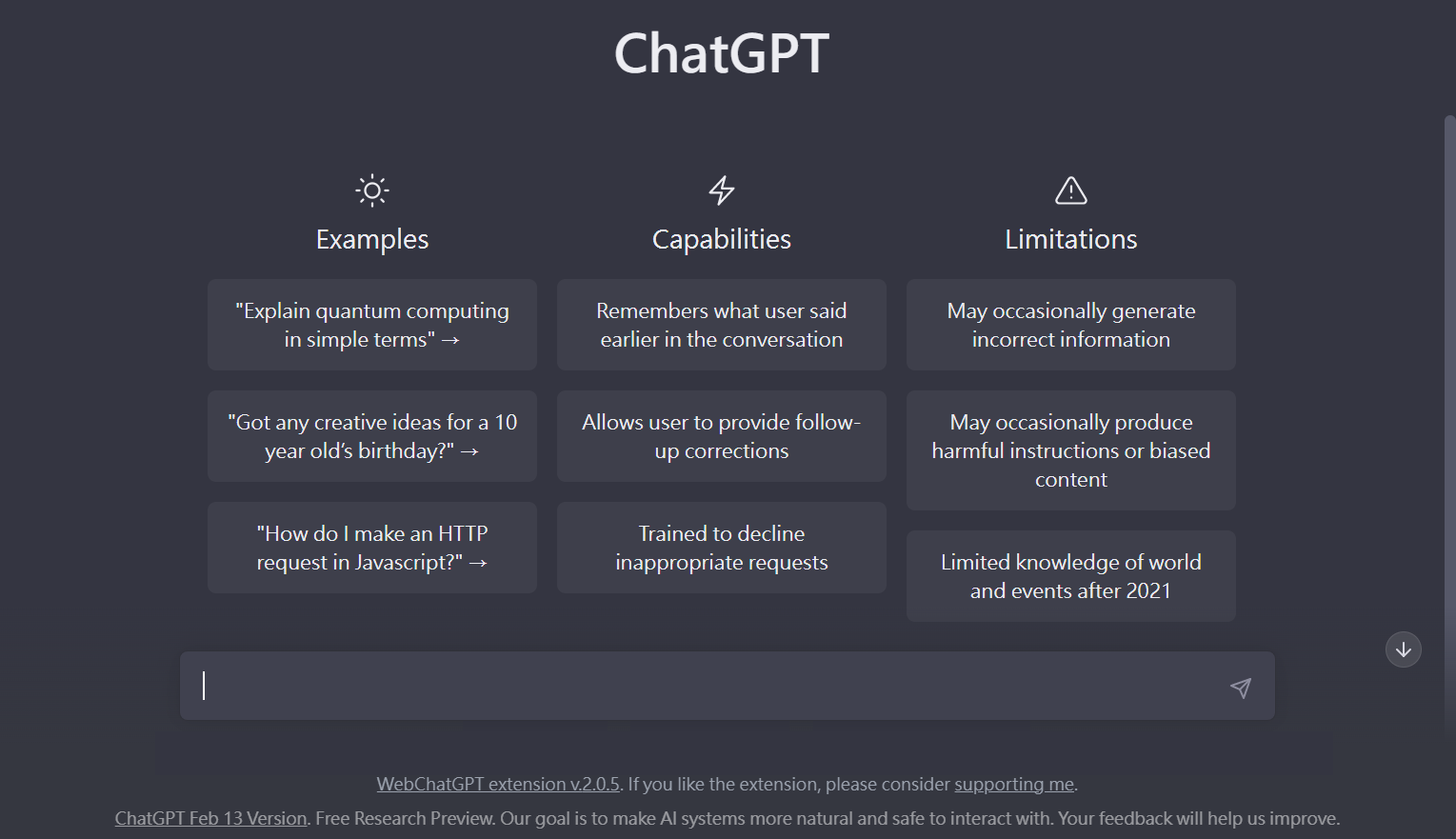

2、在對話框輸入問題即可使用(中文也可以)

只要在輸入框的地方,輸入任何你想知道的資訊,例如「為什麼會發生通貨膨脹?」、「為什麼會缺電」。ChatGPT都可快速的提供你參考資訊。

*ChatGPT資料庫目前僅至 2021年之前,故無法知道近期發生的事情;故資料僅能提供參考使用。另外ChatGPT僅能提供,這個問題最有可能的文字組合,它是基於演算法提供排列組合的文字資訊,並不真正明白你的問題。故提供的文字資訊,僅供參考使用,請勿完全信任或採用。

| 延伸學習:ChatGPT App是哪個?怎麼應用?要收費嗎?一次看懂! |

| 延伸閱讀:ChatGPT怎麼玩?一文看懂中文註冊、操作與使用外掛 |

在快速認識ChatGPT之後,我們想讓再讓你知道AI的「好與壞」。以下內容為王琍瑩律師<今天就用得上的數位科技必修課>課程裡的部份內容。

這種「蛤?什麼?」的朋友,常常會跟我說:「欸好巧喔!我才剛想說要去北海道玩,臉書就跳出來旅行社的廣告!」,並且為此感到幸福。

為了這樣的朋友,我會先試著解釋,雖然我們都用 Facebook 交朋友、看新聞,滑著 Instagram 羨慕別人的生活,但是 Facebook 和它的這些兄弟姊妹,本質上就是四個字:「廣告公司」。

我們要花錢投放廣告可以透過Facebook ,它的後台會有密密麻麻的選單,包括性別、年齡、地域、學歷、企業、財務、家庭、興趣等等,好多好多,協助我們來「建立廣告受眾」,也就是 Target Audience (TA)。

介紹到這裡,我的朋友通常就會插嘴問說:那 Facebook 怎麼會知道大家的背景、喜歡或討厭什麼呢?

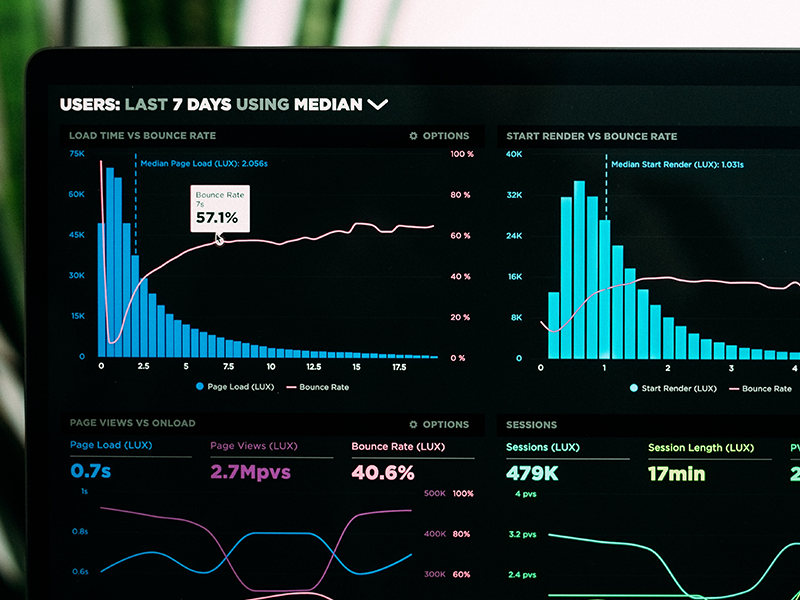

事實上,不只是 Facebook 的廣告置入,從 Google 搜尋引擎、Siri 語音助理、Netflix 影片推薦、到 UberEats 訂餐外送,這一類將使用者 Profiling (剖析建檔) 的過程,當然依賴的就是大量的數據、和協助進行數據分析的 AI 技術。

所以當朋友問我「蛤?AI 是什麼?」的時候,我的白話文答案就是「AI 讓有好的數據、又懂得善用數據的公司,想要做什麼都可以」。

(這裡的數據,包括了文字的、數字的、圖像的、語音的、行為的、生物的、動態的、靜態的⋯⋯各式各樣)

當然,這句話,把「公司」代換成「政府」也是完全無違和的。

但無論是公司或政府,這句話往往就是讓我的朋友分裂成「無限期支持 AI」和「誓死反對 AI」的原因。

一開始,AI 只是幫助在 Profiling 的過程中,猜猜看你想買什麼、想看什麼、想吃什麼。但是,隨著更多的數據和更精準的演算,AI 開始會知道像是,誰剛懷孕了、誰準備跳槽、誰又暗戀誰,這些「不能說的秘密」。

然後,無論你願不願意、承不承認,AI 會比你更瞭解你自己,這些數據和演算的結果,可能會成為貸款的信用分數、看病的用藥依據、甚至是犯罪的呈堂證供。

再更進一步,AI 其實會回過頭來操縱個人意志,決定我們該買什麼、該看什麼、該吃什麼,甚至,票投給誰。

所有機器學習 (也就是Machine Learning))的模型和成效,都取決於人為的建構,所謂類神經網路的開發,就像我們人類的學習,對一件事情,為什麼會得出這樣的結論,自己也說不上來,Deep Learning 的系統開發者,也只能判斷運算結果的好壞,而無從得知 AI 作成決策的過程,所以才被稱之為「演算法黑箱」。

既然 AI 演算法的每一筆訓練資料 (Training Data),都是已經發生的事實,那麼當這些事實存在偏見,演算法的產出,就必定是偏見的重現。這就是實務運作中,常常無意造成的演算法偏見 (Unconscious Bias)。

為了降低「演算法黑箱」可能造成的偏見,各界開始推動「Trustable AI」(可信任的人工智慧) 這樣的觀念和作法。

Trustable AI 要處理的,就是藉由提升演算法的公平性、倫理性、當責性和透明性,也就是 Fairness、Ethics、Accountability 和 Transparency (所謂的 FEAT Principles) 來設法校正這些偏見,包括大家現在非常重視的歐盟 GDPR (General Data Protection Regulation) 個資保護規範,也相當強調這樣的觀念。

聊到這裡的時候,我的「無限期支持 AI」的朋友,通常會修正為「無限期支持 Trustable AI」,但我的「誓死反對 AI」的朋友,還是會追問說:那如果是 AI 惡意使壞呢?

這當然是合理而且重要的疑慮,例如像 Deepfake 這一類AI 人體圖像合成技術,大家可能都看過媒體報導,把偶像明星的臉,移花接木到色情影片,把美國總統不曾說過的話,塞到他的嘴裡。關於網路上的訊息氾濫、真假難辨,我們之後的課程還會有很多討論,今天,我們就先樂觀地想像,既然 AI 可以為善、也可以為惡,那就表示,當有人以 AI 當矛、向外攻擊的時候,就會有人發明更厲害的 AI 為盾、加以反制。

像是 Adobe 在 2019 年發表的一項新的 AI 工具,可以把我們 Photoshop 編輯的美肌照片一張一張還原,除了可以一秒抓包我們的美肌小心機,當然也可以用來對付惡意變造的假新聞照片。如果聽眾朋友當中有 AI 應用的業者,我相信「提供更厲害的 AI solution 來對付使壞的 AI」,絕對會是一門好生意。

通常第一個問題,大家的回答都相當道德正確,到第二題,也有很多朋友會願意犧牲小我、完成大我,但是到了第三題,往往就是一陣沉默。

這就是典型 AI 應用的 Trolley Problem 倫理兩難,況且,無論「保護多數人」的這個選項多麼道德正確,在現實世界中,銷量第一的,恐怕還是能夠優先保護使用者的無人車吧!這也就是為什麼 Trustable AI 的推動,無論在民間自發的力量、或是政府公共政策的角色,都是又急又重要。